|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Articles d’actualité sur les crypto-monnaies

Petit modèle, récursif, apprentissage automatique : moins c'est plus ?

Oct 20, 2025 at 02:31 am

Explorer la tendance des modèles minuscules et récursifs dans l'apprentissage automatique, en se concentrant sur TRM et ses implications en termes d'efficacité et de performances.

The world of machine learning is constantly evolving, with researchers always seeking ways to improve performance and efficiency. Lately, there's been buzz around 'Tiny model, recursive, machine learning' approaches. Let's dive into what's shaking in this field.

Le monde de l’apprentissage automatique est en constante évolution, les chercheurs cherchant toujours des moyens d’améliorer les performances et l’efficacité. Dernièrement, il y a eu un buzz autour des approches de « modèle minuscule, récursif, d'apprentissage automatique ». Plongeons dans ce qui bouge dans ce domaine.

The Rise of Tiny Recursive Models

L'essor des petits modèles récursifs

The recent work on TRM (Tiny Recursive Model) is questioning the necessity of complexity. TRM contains 5M-19M parameters, versus 27M in HRM. These models represent a fascinating shift towards simplicity and efficiency, challenging the conventional wisdom that bigger is always better.

Les travaux récents sur le TRM (Tiny Recursive Model) questionnent la nécessité de la complexité. TRM contient 5 M à 19 M de paramètres, contre 27 M dans HRM. Ces modèles représentent un changement fascinant vers la simplicité et l’efficacité, remettant en question l’idée reçue selon laquelle plus grand est toujours mieux.

TRM: A Closer Look

TRM : un examen plus approfondi

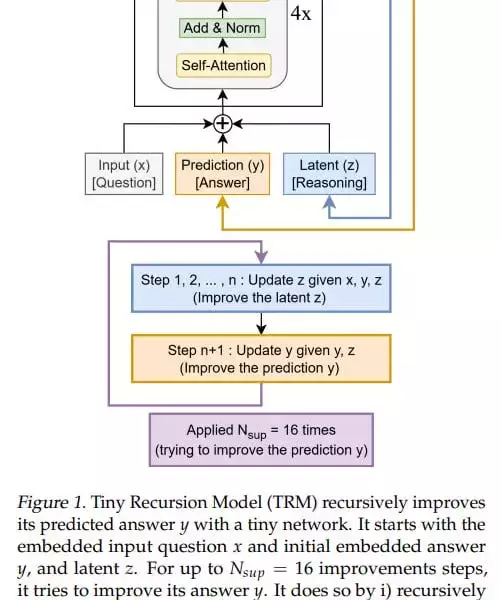

TRM simplifies the recursive process, designed with one small network, which is essentially a standard transformer block: [self-attention, norm, MLP, norm]. The model is designed so that there’s one small network, which is essentially a standard transformer block: [self-attention, norm, MLP, norm]. In the original idea, there were 4 such blocks (but after experiments they came to 2).

TRM simplifie le processus récursif, conçu avec un petit réseau, qui est essentiellement un bloc de transformateur standard : [auto-attention, norme, MLP, norme]. Le modèle est conçu de telle sorte qu'il existe un petit réseau, qui est essentiellement un bloc de transformateur standard : [auto-attention, norme, MLP, norme]. Dans l'idée originale, il y avait 4 blocs de ce type (mais après expériences, ils sont arrivés à 2).

At the input, it has three elements: input (x), latent (z), and prediction (y); they’re all summed into one value. The basic iteration, analogous to the L module in HRM, generates a latent value (z, also denoted in the recursion formula as z_L) at the layer output, and the updated z goes back to the module input, where it now adds to input (x) not as zero. The output-prediction (y, also denoted in the formula as z_H) is also added, but since it hasn’t been updated, it doesn’t change anything.

En entrée, il comporte trois éléments : entrée (x), latent (z) et prédiction (y) ; ils sont tous résumés en une seule valeur. L'itération de base, analogue au module L dans HRM, génère une valeur latente (z, également désignée dans la formule de récursion par z_L) à la sortie de la couche, et le z mis à jour retourne à l'entrée du module, où il s'ajoute désormais à l'entrée (x) non pas comme zéro. La prédiction de sortie (y, également notée z_H dans la formule) est également ajoutée, mais comme elle n'a pas été mise à jour, cela ne change rien.

Key Insights and Performance

Informations clés et performances

TRM achieves higher numbers than HRM: 74.7%/87.4% (attention version/MLP version) versus 55% for Sudoku, 85.3% (attention version, MLP version gives 0) versus 74.5% for Maze, 44.6%/29.6% (attn/MLP) versus 40.3% for ARC-AGI-1 and 7.8%/2.4% (attn/MLP) versus 5.0% for ARC-AGI-2. The experiments don’t look very expensive; runtime from <24 hours to about three days maximum on 4*H100 according to the repo.

TRM obtient des chiffres plus élevés que HRM : 74,7%/87,4% (version attention/version MLP) contre 55% pour Sudoku, 85,3% (version attention, version MLP donne 0) contre 74,5% pour Maze, 44,6%/29,6% (attn/MLP) contre 40,3% pour ARC-AGI-1 et 7,8%/2,4% (attn/MLP) contre 5,0 % pour ARC-AGI-2. Les expériences ne semblent pas très coûteuses ; durée d'exécution de <24 heures à environ trois jours maximum sur 4*H100 selon le repo.

My Two Cents

Mes deux cents

While the theoretical underpinnings of why these recursions work so well might not be fully understood yet, the empirical results are hard to ignore. TRM's architectural inventiveness, as opposed to eternal model scaling, is a breath of fresh air. It would be interesting how it would be with dataset scaling.

Même si les fondements théoriques expliquant pourquoi ces récursions fonctionnent si bien ne sont peut-être pas encore entièrement compris, les résultats empiriques sont difficiles à ignorer. L'inventivité architecturale de TRM, par opposition à la mise à l'échelle éternelle des modèles, est une bouffée d'air frais. Il serait intéressant de savoir comment cela se passerait avec la mise à l'échelle des ensembles de données.

Looking Ahead

Regarder vers l'avenir

The journey of 'Tiny model, recursive, machine learning' is just beginning. There's a lot more to explore. So, let's keep an eye on these tiny titans and see where they take us next. Good recursions to everyone!

Le voyage du « petit modèle, récursif, apprentissage automatique » ne fait que commencer. Il y a beaucoup plus à explorer. Alors gardons un œil sur ces petits titans et voyons où ils nous mèneront ensuite. Bonnes récursions à tous !

Clause de non-responsabilité:info@kdj.com

Les informations fournies ne constituent pas des conseils commerciaux. kdj.com n’assume aucune responsabilité pour les investissements effectués sur la base des informations fournies dans cet article. Les crypto-monnaies sont très volatiles et il est fortement recommandé d’investir avec prudence après une recherche approfondie!

Si vous pensez que le contenu utilisé sur ce site Web porte atteinte à vos droits d’auteur, veuillez nous contacter immédiatement (info@kdj.com) et nous le supprimerons dans les plus brefs délais.

-

-

- Consensus 2026 Miami : Web3, Blockchain, Crypto-monnaie, NFT, Metaverse, conférence, 5 mai — Là où Wall Street rencontre la frontière numérique

- May 01, 2026 at 11:27 pm

- Miami vibre à l'approche du Consensus 2026 le 5 mai, mettant en avant le Web3, la blockchain, la crypto, les NFT et le passage du métaverse du battage médiatique à la réalité institutionnelle et durable.

-

- La Fed maintient ses taux stables, déclenchant une baisse du prix du Bitcoin dans un contexte de tensions géopolitiques

- May 01, 2026 at 04:04 am

- La décision de la Réserve fédérale de maintenir les taux d'intérêt, associée au conflit au Moyen-Orient, a un impact sur le prix du Bitcoin. Analyse des tendances récentes et des réactions du marché.

-

- Les mineurs de Bitcoin électrifient le réseau : l'acquisition d'une usine à gaz dans l'Ohio ouvre une nouvelle ère pour l'or numérique

- Apr 30, 2026 at 10:38 pm

- L’industrie minière du Bitcoin connaît une transformation significative, avec des acteurs majeurs développant de manière agressive leurs opérations et acquérant stratégiquement des actifs énergétiques comme les usines à gaz de l’Ohio pour solidifier leur avenir dans l’économie numérique.

-

- Le jeton MEGA de MegaETH arrive dans la Big Apple : définition de nouveaux critères de performance pour la blockchain en temps réel

- Apr 30, 2026 at 09:11 pm

- Le MEGA Token de MegaETH a été officiellement lancé, validant sa vision de la blockchain « en temps réel » avec un modèle de distribution axé sur les performances et une adoption rapide du stablecoin USDM.

-

- La pente glissante de Solana : les prévisions de prix indiquent une perte de résistance et de nouvelles baisses potentielles

- Apr 30, 2026 at 09:08 pm

- Solana a du mal à briser la résistance clé, signalant un potentiel de baisse. Des refus répétés entre 86 et 88 dollars, associés à une tendance à court terme brisée, laissent présager des objectifs aussi bas que 67 dollars, voire 40 dollars, alors que les vendeurs gardent le contrôle. Les investisseurs doivent surveiller de près les niveaux de support critiques.

-

- BTC, pétrole, bénéfices : la géopolitique alimente le brut, le dérapage des cryptos, les triomphes et les essais de la technologie

- Apr 30, 2026 at 04:51 pm

- Les marchés mondiaux sont en tourbillon : le BTC chute alors que le pétrole atteint des sommets pluriannuels en raison des tensions géopolitiques, tandis que les géants de la technologie affichent des bénéfices mitigés, révélant un paysage financier complexe.

-

- Le nouveau rythme de New York : les systèmes de jalonnement, l'USD1 et la gouvernance conduisent la prochaine vague de crypto

- Apr 30, 2026 at 03:02 pm

- Des événements lucratifs générant 1 USD aux modèles de gouvernance robustes, la sphère crypto regorge d'innovations qui remodèlent la façon dont nous interagissons avec les actifs numériques, en nous concentrant sur l'engagement à long terme et l'utilité du stablecoin.

-

- OKX dévoile le protocole de paiement des agents : inaugurant une nouvelle ère de transactions IA

- Apr 30, 2026 at 02:53 pm

- OKX lance son Agent Payments Protocol (APP), une norme ouverte pour le commerce piloté par l'IA, permettant aux agents de gérer des cycles économiques complets. Explorez les implications pour les transactions IA et les paiements agents.